Viele Menschen fürchten sich vor dem Potenzial der Künstlichen Intelligenz. Betrachtet man den gegenwärtigen Stand der Technik, kommen allerdings ganz andere Gefühle ins Spiel. Ein Essay.

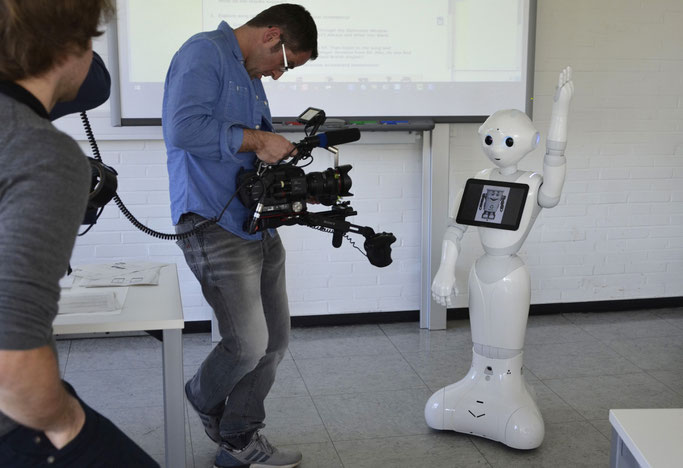

Das ist Pepper. Er grüßt seine Studenten. Und das Kamerateam. Foto: Pressestelle Philipps-Universität Marburg

VIELLEICHT BIN ICH NAIV. Vielleicht sehe ich nur nicht die drohende Gefahr: intelligente Maschinen, die wie in den Terminator-Filmen die Macht an sich reißen, die danach trachten, ihre Schöpfer, uns Menschen, zu vernichten. Weil wir so beleidigend unvollkommen sind. Und weil wir doch die einzige Instanz darstellen, die die Maschinen überhaupt noch stoppen könnten.

Ein drastisches Szenario, zugegeben. Und doch eines, das so ähnlich immer häufiger auftaucht, sobald das Schlagwort "Künstliche Intelligenz" zur Sprache kommt. Und zwar, das ist das Erstaunliche, sowohl beim Smalltalk auf Parties oder in der Mittagspause als auch bei hochoffiziellen forschungspolitischen Diskussionsveranstaltungen.

Die Angst ist da. Und sie steht in einer augenfälligen Diskrepanz zu den Beschwörungen führender Wissenschaftler in Richtung Politik, Europa und speziell Deutschland drohe den Anschluss zu verlieren bei diesem entscheidenden Zukunftsthema. Im nächsten Satz enthalten diese Beschwörungen dann Firmennamen wie Google, Amazon & Co, deren Fortschritte bei der KI so gewaltig seien wie die eingesetzten Forschungsbudgets.

Haben Sie zum Beispiel schon von Google Duplex gehört, diesem digitalen Assistenten, der im Restaurant Ihrer Wahl anruft oder beim Friseur um die Ecke, um einen Termin zu vereinbaren? Und zwar so, dass die Person am anderen Ende der Leitung gar nicht merkt, dass sie nicht mit einer Maschine verbunden ist. "Google Duplex ist gruselig gut", titelte Spiegel Online neulich über die Entwicklung, die vom Sommer an in den USA getestet werden soll.

Oder nehmen wir die selbstfahrenden Autos, die in ein paar Jahren Standard sein werden und an denen Firmen wie Tesla oder wiederum Google aggressiv arbeiten. Sie werden im Extremfall im Bruchteil einer Sekunde Entscheidungen treffen müssen, ob sie bei einem Unfall lieber den Radfahrer ummähen oder die Autoinsassen gegen den Brückenpfeiler lenken.

Wohin führt das, heißt die häufig nicht einmal ausgesprochene Frage am Ende solcher Berichte. Die dann in den oben erwähnten Gesprächen immer häufiger wie dargestellt beantwortet wird: Terminator und so. Oder Goethes Zauberlehrling. Den hätten offenbar viele Deutschen immer noch im Kopf, sagt die Soziologin Cordula Kropp, die gerade eine Studie zur Technikfreundlichkeit der Deutschen vorgestellt hat.

Wie gesagt: Vielleicht bin ich naiv. Ich denke in solchen Debatten eher an mein iPhone und an die hilflose Art, wie Siri meine Fragen beantwortet. Künstliche Intelligenz in Serie ist derzeit in etwa so spontan und zu geistreichen Dialogen aufgelegt wie die Sachbearbeiterin am Empfangstresen des örtlichen Finanzamts. Wobei die, das sei ihr zugestanden, deutlich intelligenter ist.

Ein anderes Beispiel Künstlicher Intelligenz löst bei mir noch seltsamere Gefühle aus: Mitleid. Seit einem Jahr lässt sich der Marburger Linguistikprofessor Jürgen Handke in einigen seiner Lehrveranstaltungen von bis zu vier humanoiden Robotern begleiten, darunter Pepper und Yuki, je 1,20 groß. Die beiden können durch den Hörsaal fahren, ihre nur 60 Zentimeter kleinen Kollegen Nao und Miki könnten das auch, dürfen aber normalerweise nicht, weil sie ständig irgendwo herunterzufallen drohen. Die vier Roboter stellen den Studenten kleine Quizfragen, sie können auch selbst mal eine Lexikon-Definition zum Besten geben. Manchmal verwickelt Handke Pepper und seine Kollegen auch in ein Gespräch, und mit ganz viel Glück spricht der Professor deutlich genug, dass sein Roboter die vorher einprogrammierten Stichwörter versteht, um dann die ebenfalls vorher einprogrammierte Antwort zu geben. Häufig aber steht der Roboter auch einfach hilflos herum, dreht den Kopf mit den Mikrofonen daran in alle Richtungen und macht dabei halbwegs menschliche Gesten – die sich allerdings alle paar Sekunden exakt wiederholen. In so einem Moment will ich Pepper umarmen und ihm sagen, dass alles gut wird.

"Wer wissen will, wo wir in Sachen künstlicher Intelligenz stehen, muss sich nur mal in meine Lehrveranstaltung setzen", sagt Handke, der zahlreiche Lehrpreise gewonnen hat, immer wieder neue Formate ausprobiert und deshalb auch bei dem vom Bundesministerium für Bildung und Forschung finanzierten Roboter-Test mitgemacht hat. Man schaut Handke zu und wird bei allem Mitleid mit den Robotern plötzlich ganz entspannt.

Es mag ja sein, dass die internationalen Tech-Konzerne ganz andere Innovationen in ihren Schubladen haben, an den sie uns nur nicht teilhaben lassen. Zu hören ist allerdings auch, dass selbst Google Duplex bei seiner Premiere auf der Google-Entwicklerkonferenz nur deshalb so atemberaubend herüberkam, weil die vorgeführten Telefonanrufe vorher aufgenommen waren. Und weil das System offenbar sehr überzeugend menschliche Stimmen imitieren kann. Über seine Spontaneität sagt all das wenig – oder wahrscheinlich angesichts des von Google streng kontrollierten Settings doch wiederum sehr viel.

Will ich damit der KI ihren bevorstehenden Triumphzug absprechen? Keineswegs. Aber was meines Erachtens immer offensichtlicher wird: dass Künstliche Intelligenz hervorragende Leistungen bei der sinnhaften Zuordnung von Daten (siehe Facebook) und bei der Bewältigung vorher definierter Szenarien (siehe autonomes Fahren) wird leisten können. Intelligenz im eigentlichen Sinne ist das nicht. Sondern bestenfalls, wie mir neulich ein Gesprächspartner sagte, "die Simulation von Intelligenz".

Bleibt ein Einwand, der schwer zu entkräften ist, weil er so spekulativ in die Zukunft hineinreicht: Was wissen wir denn heute, wie schnell die technologische Entwicklung fortschreitet? Das sogenannte Mooresche Gesetz besagt schließlich, dass sich die Rechnerleistung alle 12 bis 24 Monate verdoppelt. Dass der Intel-Mitbegründer Gordon Moore, der die Regel 1965 formulierte, bislang Recht behalten hat, bestätigen viele IT-Experten. Was, so das Joker-Argument der Terminator-Whistleblower, die Vorhersage, was in zehn oder 15 Jahren technisch möglich ist, gänzlich unmöglich mache.

Okay, einverstanden. Ich würde mich angesichts des Mooresche Gesetzes sogar zu dem Optimismus hinreißen lassen, dass ich in 15 Jahren mit Siri ein passables Gespräch über Arnold Schwarzeneggers schauspielerische Leistung führen kann. Weil Siri dann in der Lage ist, die entsprechenden online verfügbaren Kritiken auszuwerten, zu gewichten und dann noch in eine Gesprächssituation zu übertragen. Was eine phänomenale und – aus heutiger Sicht ehrlich gesagt –unvorstellbare Leistung wäre. Mit Bewusstsein und Kreativität, die übrigens auch die Voraussetzung der anfangs postulierten Bösartigkeit der Maschinen wären, hat all das immer noch rein gar nichts zu tun.

Bei einer anderen Prognose bin ich dagegen deutlich pessimistischer. Wenn wir als Gesellschaft weiter so viel Angst vor der KI haben, dann wird meine Gesprächspartnerin Siri bzw. ihre Nachfolgerin auch in 15 Jahren auf Komponenten und Technologien basieren, die in Amerika entstanden sind oder in Asien – aber wahrscheinlich nicht in Deutschland. Derzeit stamme keines der 100 weltweit am höchsten bewerteten KI-Startups aus der Bundesrepublik, hat die Süddeutsche Zeitung neulich vorgerechnet.

Morgen Abend lädt Angela Merkel zum "Expertengespräch Künstliche Intelligenz" ins Kanzleramt. In ihrem Koalitionsvertrag kündigen Union und SPD an, Deutschland zu einem "weltweit führenden Standort bei der Erforschung von künstlicher Intelligenz" ausbauen zu wollen, inklusive einem nationalen Forschungskonsortium und einem deutsch-französischen Zentrum für KI. Ehrgeizige Pläne. Ich sehe ihnen freudig entgegen. Aber vielleicht bin ich auch nur naiv.

Kommentar schreiben

tutnichtszursache (Montag, 28 Mai 2018 18:01)

Vielen Dank, Herr Wiarda. Digitalisierung vom Kopf auf die Füße gestellt, sehr erfrischend.

Laubeiter (Dienstag, 05 Juni 2018 11:33)

Ein Gedankenspiel: Kernenergie war ne tolle Technik, Strom billig herzustellen, sogar CO2-frei, Deutschland stieg ein, nicht so stark wir Frankreich, aber mit ähnlichen Anteilen wie in USA, Kernforschungs-anlagen, -zentren wurden große Arbeitgeber in der Forschung. Dann kamen Kerntechnik-Unfälle, erst einer in der Sovietunion, der liess sich ignorieren, dann einer in Japan, der liess sich nicht ignorieren, Deutschland stieg wieder aus, Kernforschungs-anlagen. Was wäre, wenn AI so lange wüchse, wie kein Unfall passiert, dann aber wieder aufgegeben wird, weil sie unfallträchtig ist?